La Cnape examine les enjeux du recours à l'intelligence artificielle pour les associations de protection de l'enfance et se positionne sur les conditions de son intégration dans les pratiques professionnelles. En particulier, les usages de l'IA "à haut risque" doivent être évités.

Face aux perspectives ouvertes par l'intelligence artificielle dans les pratiques professionnelles (amélioration des écrits professionnels, automatisation des plannings, synthèses…), la Fédération des associations de protection de l’enfant (Cnape) publie une première note de positionnement sur le recours à l'IA en protection de l'enfance.

Elle y évoque notamment les « interrogations éthiques et juridiques majeures » qu'elle soulève. « L'IA est-elle un outil pertinent pour notre secteur ? Quels usages en faire et à quelles conditions, quels impacts pour les professionnels, les enfants et les jeunes, et quelles responsabilités ? ».

Ce document est le fruit d'un groupe de travail lancé en 2025. Il se veut complémentaire de la recherche action engagée par la DGCS et le LaborIA en vue de la création d'une convention professionnelle sur l'usage de l'IA dans le travail social.

Interrogations

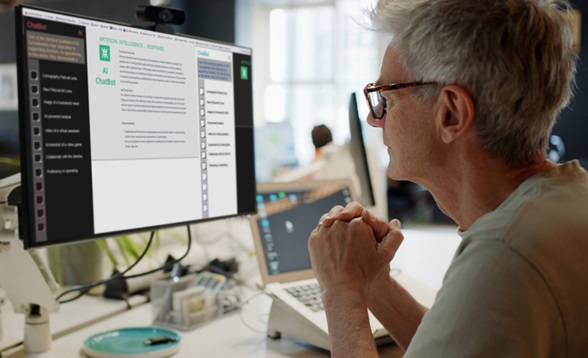

Dans la protection de l'enfance, certains outils comme ChatGPT ou des « assistants intégrés » (Microsoft Copilot…) « peuvent améliorer la qualité formelle des écrits, la rapidité d’exécution, et la structuration de l’information », relève la Cnape.